百“模”混战

撰文 | 吴坤谚 编辑 | 王 潘 “面向AI时代,所有应用都值得用大模型重做一遍。” 4月11日的2

撰文 | 吴坤谚

编辑 | 王 潘

“面向AI时代,所有应用都值得用大模型重做一遍。”

4月11日的2023阿里云峰会上,阿里巴巴集团董事会主席兼首席执行官、阿里云智能集团首席执行官张勇的这句话其实有些给他人作注之嫌,APUS创始人李涛曾说过一句更提振人心的话:几乎所有行业,都值得被人工智能重做一遍。

随后,阿里云智能首席技术官周靖人正式宣布推出大语言模型“通义千问”。他介绍称,通义千问是一个超大规模的语言模型,功能包括多轮对话、文案创作、逻辑推理、多模态理解、多语言支持,能够跟人类进行多轮的交互,也融入了多模态的知识理解,且有非常强的文案创作能力,能够续写小说,编写邮件等,可以极大增加我们的工作效率。

随着阿里AI大模型——通义千问的正式亮相,以及百度、华为、360等互联网头部企业前后脚推出自己的AI大模型,属于AI,又或者说是属于AI大模型的时代到来。但究其根源,大模型在ChatGPT的破圈效应下引发大厂们小步快跑进场,也只是冷饭热吃。

早在2018年,谷歌便提出超大规模预训练语言模型BERT,2020年,OpenAI推出GPT-3超大规模语言训练模型,参数达到1750亿,用了大约两年的时间,实现了模型规模从1亿到上千亿级的突破,并能实现作诗、聊天、生成代码等功能。

2021年,国内大厂也感受到了大模型的东风,华为云发布盘古NLP超大规模预训练语言模型和盘古α超大规模预训练模型、阿里达摩院发布十万亿参数的多模态大模型M6、以及百度也推出了如今文心一言的前身——ERNIE 3.0 Titan。如果说大模型的元年,其实2021年可能更合适。

总的来说,这一阶段的大模型还充满着“等风口”的阶段,只是彼时的AI大模型尚欠缺商业模式的落地支撑,例如盘古NLP模型在面世之初便确定了自己to B的定位,直至ChatGPT凭借出色的交互以及开放性测试在全球掀起AI狂潮。

于是大厂们纷纷捡起自己的复现成果,调用起云业务中闲置的算力,亦步亦趋地追赶,希望能够后发先至。

泛滥的大模型

OpenAI为大家找到了产品落地之路,引发一众大厂一哄而上。

本轮“狂飙”下的第一个玩家是百度,百度本身浸淫搜索领域、中文垂类知识多年,掌握大量高质量通识数据,而且早在2010年便成立了自然语言处理部,本就是大厂中最早探索AI的一批,如今也是最早推出了类GPT应用文心一言。

4月以来,大模型井喷,入场者接连发布大模型的新闻消息应接不暇。

4月9日,360在2023数字安全与发展高峰论坛上发布类GPT大模型“360智脑”,周鸿祎亲切地称其为“刚生出来的孩子”。4月10日,自学术圈走进商界的AI独角兽商汤科技对外发布了“日日新SenseNova”大模型体系,推出自然语言处理、内容生成、自动化数据标注、自定义模型训练等多种大模型及能力并提供实机演示。

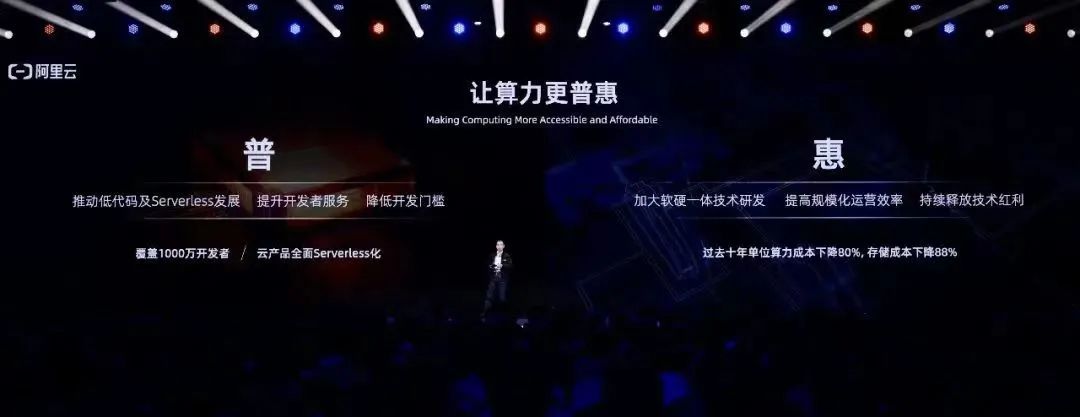

4月11日,阿里在2023云峰会上发布“通义千问”大模型并向社会企业开放使用,邀请企业参与共创自己的大模型。发布会上,张勇在宣布将阿里系应用接入大模型重做时,炫富式地展示了阿里系那令人眼花缭乱的商业应用,完善的APP矩阵与数字商业积累显然成为大模型训练的基石。

紧随其后的腾讯“混元”大模型与华为的“盘古”大模型,一个把守着丰富的社交场景与信息流数据,另一个也手握智能硬件的高频流量,而且两者都通过云服务的市场地位获取了极富商业价值的数据资产。

无论好坏,即使是“刚生出来的孩子”也要“抱出来给大家看”,众大厂赶鸭子上架式的密集发布大模型,怎么看都有点飞蛾扑火的意思。

首先,构建大模型是很难迅速产生商业价值的。参考大模型渴望复现的openAI,尽管在微软的投资下,其公司估值越来越高,但至今仍未实现盈利。芯片、能耗、数据资产等刚性成本也将随着入场者的增加水涨船高。在行业“乍暖还寒”、降本增效的当下,将宝贵的现金流投进AI的无底洞,未必是一个好主意。

其次,大模型并非通往强人工智能的唯一道路。随着数据不断增长,算力持续提升,优化手段越来越好,模型也会越来越大。无数人工神经元分层排列,而参数量描述了神经元之间连接强度的可调值。模型的预训练就是在已知文本的基础上不断重复执行并调整这些参数,以便算法下次做得更好,也就是我们所说的“调教”。

只是堆砌再多文本,AI习得的语言模式也无法让其真正诞生逻辑思维,模仿不了数学推理。目前亦步亦趋在ChatGPT3.5之后的大模型们也将遭遇前者的困境。既然不是为了AI功能性的升级,那么耗费海量算力与“钞能力”的目的也显而易见,ChatGPT为我们拉开了AI大模型商业化落地的大幕,紧随其后上台的人当然要赚上同样的吆喝。

正如微软向OpenAI投资100亿美元,将GPT全面接入自家应用一样,让浩如江海的中小企业通过自己的大模型来打造属于相应的中小模型,是OpenAI昭示的商业落地路径。大模型的井喷是这条路径的复现,遵循着相同范式——花大钱做“费力不讨好”的大模型,争取市场地位。

这一范式实际上也不新鲜。打个比方,在数字化时代下的应用需要一个操作系统,微软凭借Windows占据PC头把交椅,即使后来者创造了无数使用体验更好的产品,也难以动摇微软的地位,因为这些产品的开发都基于Windows这个操作系统。

而智能化时代同样需要操作系统,在OpenAI进不了国门的前提下,市场自然会寻求替代品,如今的大模型之争本质上是下一代操作系统之争。面对当下国内大模型喷涌,APUS李涛认为,“所有人在争大模型的本质,实际上是争操作系统的话语权,一旦谁能控制,就会获得最大的商业回报”。

在他看来,中小模型对应商业场景,因此中小企业应致力于此;大模型对应行业标准,获取话语权意味着主导未来生态。

AI浪潮前,我们共同经历数字化,平台作为流量的集中入口,主宰移动互联网商业的变现能力。AI浪潮下,我们共同经历智能化,大模型作为操作系统,主宰云上的业务和应用。谁都想成为下一个谷歌和微软,但过程想必不会轻松。

算力、场景、文本的堆砌归根结底是一个钱字,飞蛾扑火中的玩家们有享受烧的过程的、有燃烧自己照亮他人的、当然也有向往光明的。

正如李开复所言:“AI 2.0时代已经到来,会诞生比移动互联网大10倍的机会。”

大模型的主航道在哪?

More is different。

AI大模型或许还不是无所不能,但在要素的堆砌下,大模型无疑能兼容更多的场景和领域。如果说大模型的第一步是通用于各行各业,那么第二步飞跃便是在垂类场景中降本增效。

既然目标是星辰大海,玩家们手中怎能缺了恶魔果实?

算力是AI发展的基础三要素之一,是训练AI进行海量数据的重复多轮处理的能力。据OpenAI测算,2012年开始,全球AI训练所用的计算量呈现指数增长,平均每3.43个月便会翻一倍,目前计算量已扩大30万倍,远超算力增长速度。GPT的迭代便足以直观呈现算力需求的井喷,GPT-3模型参数量有1750亿,是GPT-2的100余倍。下一代GPT-4模型的参数量虽未公布,但业内人士预测其参数量足有上万亿。

公开信息显示,GPT-3大模型需要训练355个GPU/年,假设企业以一个月为期限训练自己的大模型,将需要4260个AI加速卡方可让产品面世。而这只是参与游戏的“入场券”需求,更重要的是通用大模型在垂类场景中展现的效能,而效能源自于大模型在高价值文本下的不断训练。

换言之,谁手里掌握更多、更有价值、更普世的场景与数据,谁做出来的大模型更好。

首先我们得恭喜在移动互联网时代中把握巨大流量入口的企业们,社交、电商、搜索等人们日常生活中不可避免的应用所产生的数据,具备让大模型to C商业化落地的可能。其次我们还要恭喜数据库厂商,各类垂直数据库不可避免地成为大模型眼中的香饽饽,只是多个数据库间不互通以及模型导入、存储、使用等问题还有待解决方案。

大模型是唯一的正确道路?

AI模型一定是越大越好吗?

知名期刊《Nature》就此议题采访了多位专家,并发表了名为《In AI,is bigger always better?》的研究,一些科学家认为,更大的模型只是在回答训练数据相关范围内的查询上变得更好,并不能获得回答全新问题的能力。

人工智能前沿的争论之声未消,但目前的通用大模型并不能真的通用于千行百业。一位业内人士认为,大模型最有价值的地方是通用性强,例如可以支持数以万计,甚至十万计的小模型。

大模型虽好,却是一门昂贵且需要耐心的事情。为了大模型的规模效应,巨量算力成本背后的芯片与电力消耗已然成为掣肘AI进一步发展的锁链。而且以目前训练大型语言模型所涉及的数据、计算能力和费用来看,只有拥有超大计算资源的公司才能做到。

以谷歌与柏林大学合作研发,用来和GPT3打对台的PaLM为例,5400亿的恐怖参数下,研究人员测算其训练一次的成本便上千万美元,谷歌自己在训练PaLM的两个月内便耗电3.4千兆瓦时,这相当于大约300个美国家庭一年的能源消耗。

即便谷歌称其所耗能源构成有89%为清洁能源,但目前国内主流发电形式仍是火电和“看天吃饭”的水电。

芯片方面,由于目前国产自研芯片最高端水准的14nm芯片只能覆盖云计算算力需求而无法覆盖AI算力需求,大模型构建同样面临“卡脖子”问题。大模型算力需求的英伟达GPU芯片一方面成本高昂,单块1万美元到2万美元的售价反映在大模型构建上,便是数十亿美元。国内大模型玩家还能腾出多少闲置芯片来训练大模型?例如阿里的存粮能给大模型匀多少量还是一件值得深究的事情。

再者是,目前的中国企业与个人并不是非大模型不可。即使忽视大模型真的面向千行百业后,在训练上将产生的巨额功耗与成本,我们也不能忽视目前诸多垂类行业数据稀缺、逻辑难以被AI所理解模仿的现状。

而且,程序员们一定知道多任务、多线程可是会互相打架的。按照张勇在阿里云峰会上提出的“用大模型重做各个应用”,用各行各业具有冲突性的数据训练,不一定能提高垂类行业使用模型的效能。在参数猛增的情况下,精度未必能一直持续上涨,即使是Transformer架构,也具有它的极限。

相同大模型“赋能”之下的同质化人才同样不具备竞争力,而是被AI覆盖的“时代的眼泪”。相反,如果AI能成为个人的个性化化身,是放大自身能力的小模型,说不定还能在被大模型覆盖的世界中杀出一条血路。

那么能不能用大模型对小模型蒸馏,让大模型学习小模型的成果呢?目前这一做法面临大小模型架构差异的问题,如何顺畅互通还是未知数。

不论AI的未来是more is different还是less is more,通用大模型的“通用”二字还是要打上一个问号。

原文标题 : 百“模”混战