英特尔公布AI大模型,布局AI芯片

因为ChatGPT点起来的AI大模型这把火,已经连着烧了好几个月了。每当人们觉得差不多卷到头了的时候,就会有大厂跳出来再给这把火添点柴。互联网大厂卷完,轮到芯片厂了。这不,英特尔近日公开了自己的Aurora genAI模型,据称参数量高达1万亿

因为ChatGPT点起来的AI大模型这把火,已经连着烧了好几个月了。

每当人们觉得差不多卷到头了的时候,就会有大厂跳出来再给这把火添点柴。

互联网大厂卷完,轮到芯片厂了。

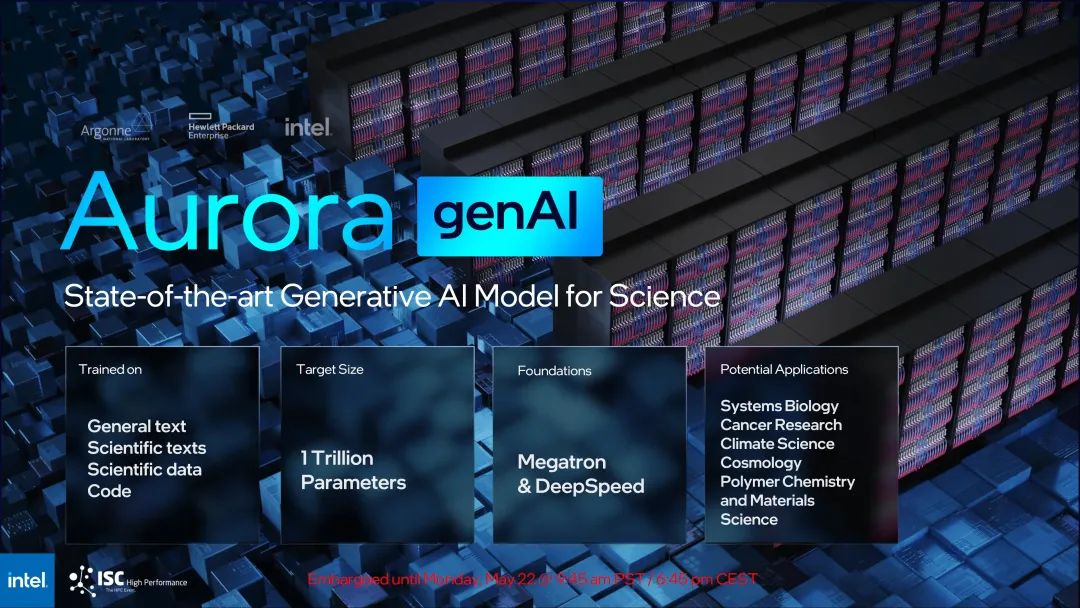

这不,英特尔近日公开了自己的Aurora genAI模型,据称参数量高达1万亿。

给超算准备的大模型

用英特尔自己的话来说,Aurora genAI由英特尔、HPE和Argonne联手开发。未来将用于科学计算领域,包括生物学、癌症、大气科学、天文学、高分子化学等多个领域。

为什么是“科学计算领域”?因为这个AI大模型名字的来源就是台超级计算机——Aurora。

自打2021年,英特尔就宣布为美国阿贡国家实验室打造一台Aurora超级计算机。这之后历经多次更改计算平台和工艺架构,所以迟迟不见落地,对其性能也是秘而不宣。

而在近日的德国汉堡举行的高性能计算展上,英特尔终于正式揭露了这台超算的一些参数。

Aurora超级计算机采用英特尔Xeon(至强)CPU Max和Xeon GPU Max系列芯片的支持,并将计算能力从最初的1 Exaflop(100亿亿次)提升至2 Exaflop(200亿亿次),使其与基于AMD芯片的Frontier超级计算机媲美(Frontier是目前已公布的地球上最强超级计算机)。

Aurora超算有10624个节点,每个节点2组CPU和6组GPU。CPU采用Sapphire Rapids-SP架构,总共21248个;GPU采用Intel的最强Ponte Vecchio,总共63744个。

Aurora genAI就是Aurora超级计算机的配套模型。Aurora genAI 模型以 Megatron 和 DeepSpeed 为基础,其规模达到了 1 万亿参数,相比之下 ChatGPT 的规模仅为 1750 亿参数,当然还远不及GPT4的百万亿参数。

Aurora genAI 模型将在通用文本、科学文本、科学数据和与该领域相关的代码上进行训练。按照设想,它的潜在应用范围大概是:

推动清洁能源聚变研究

催化剂研究

癌症研究

航空航天研究

神经科学研究

宇宙学研究等

押宝AI芯片,对决英伟达

据英特尔自己介绍,由于英特尔数据中心GPU Max系列处理器的加持,实现了超过英伟达(NVIDIA)A100和AMD Instinct MI250X加速器的最快SimpleFOMP性能。英特尔也强调这款系统的表现会优于使用英伟达H100芯片的HPC。

众所周知,现在各个大模型训练算力几乎全部来自英伟达的A100和H100GPU。

所以从公布的信息中,能发觉英特尔不是单纯地在说这台超算的能力,而是矛头直指GPU霸主英伟达。

当然理想是美好的。和英伟达比起来,英特尔在AI芯片业务的市场份额几乎为零。

2021年英特尔宣布Aurora超算时,对在上面应用的“Ponte Vecchio”旗舰数据中心GPU寄予厚望。但之后项目不断跳票,让英特尔失去了先机。

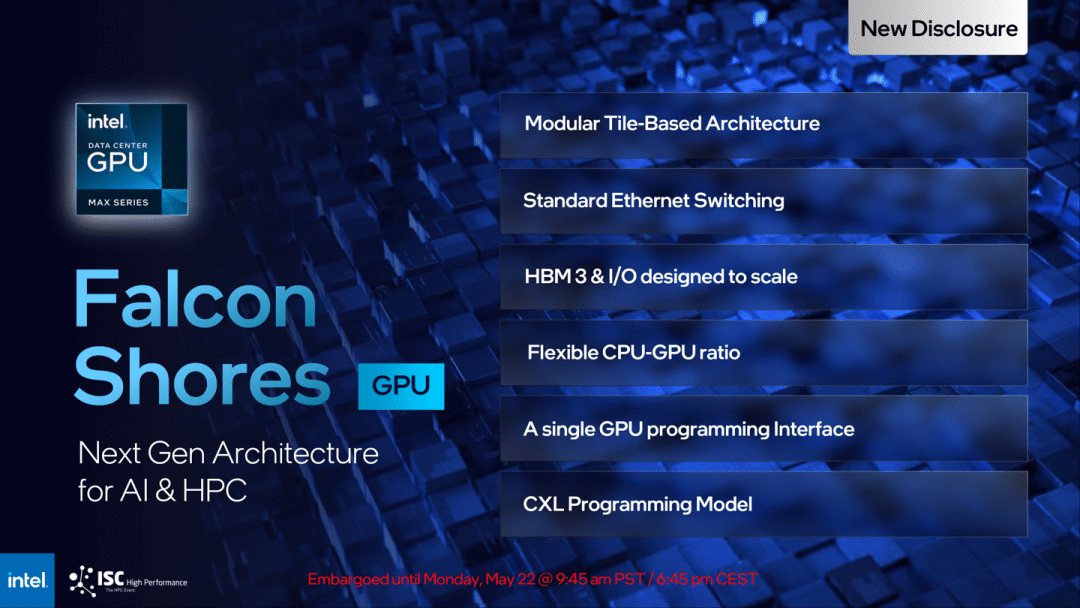

现在英特尔将希望押注在全新的“Falcon Shores GPU”身上,它是在Aurora超算上使用的“Ponte Vecchio”的 Max 系列 GPU 继任者。

这也代表了英特尔关于如何构建下一代超级计算芯片的思维转变。他们决定暂时搁置将 CPU 和 GPU 集成到 XPU的战略计划,专心搞好Falcon Shores,应对接下来的挑战。

英特尔既有远虑,又有近忧。

根据英特尔的计划,Falcon Shores GPU最快也要2025年投产。而另外一个宿敌AMD将在今年晚些时候推出他们的Instinct MI300芯片,这被AMD视作挑战英伟达H100的杀手锏,并将为劳伦斯利弗莫尔国家实验室的 2 exaflops(峰值)超级计算机 El Capitan 提供动力。

此外,微软、谷歌、亚马逊也都开始下场研发AI芯片。粗略统计,这三家已经推出或计划发布8款服务器和AI芯片。虽然英特尔贵为芯片龙头,但在AI领域毕竟涉猎未深。面对这几位巨头的持续发力,英特尔真的压力山大。

而在几年之后Falcon Shores成功出世之时,真正的强敌英伟达又会拿出怎样的“核弹”来结束这场对决,还是未知数。