英伟达也搞起大模型?这回是为了芯片设计

因为AI对算力的庞大需求,市面上母咚懔PU一直是各方争抢的香饽饽,而英伟达也因此赚得盆满钵满。不过现在英伟达又动起了别的心思。自己作为GPU厂商,为什么不下场做大模型呢?近日,英伟达推出了自家的全新大模型——ChipNeMo,号称拥有430亿参数

因为AI对算力的庞大需求,市面上的高算力GPU一直是各方争抢的香饽饽,而英伟达也因此赚得盆满钵满。不过现在英伟达又动起了别的心思。

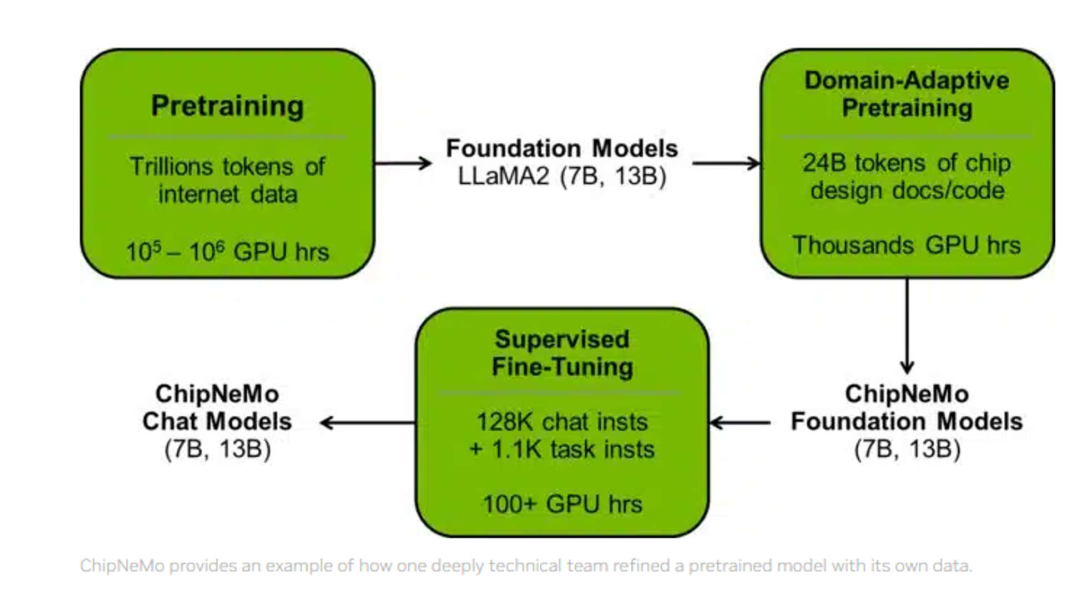

自己作为GPU厂商,为什么不下场做大模型呢?近日,英伟达推出了自家的全新大模型——ChipNeMo,号称拥有430亿参数。

专为芯片设计而生的大模型

据英伟达官方表示,ChipNeMo专注于辅助芯片设计,旨在提高工程师的工作效率。这一大语言模型的应用范围广泛,包括问答、EDA脚本生成和Bug总结等任务,使芯片设计变得更加便捷。

图源:站长之家

研究人员并没有直接部署现成的商业或开源LLM,而是采用了以下领域适应技术:自定义分词器、领域自适应持续预训练(DAPT)、具有特定领域指令的监督微调(人工智能来改进自己的产品,比如在其GPU产品设计工作中,大量采用人工智能辅助,来加速以及最佳化GPU芯片的设计,相关设计甚至涉及供电模拟设计、从电路到GPU规模的大型积体电路设计、架构网络以及储存系统管理等。

同时,英伟达依托人工智能芯片设计工具,可以根据标准的处理单元布局来自动产生芯片的设计图,也可以用来检验人类员工设计出来的芯片布局中有无错误。据Bill Dally当时的说法,这套工具只需要在配备两个GPU的平台上,短短几天的时间,就可以超过一组十人员工一年的工作份量。

今年3月,英伟达也推出了四款推理平台。这些平台针对各种快速兴起的生成式AI应用进行优化,能够帮助开发人员快速构建用于提供新服务和洞察的 AI 驱动的专业应用。这些平台可以将NVIDIA全栈推理软件与最新的 NVIDIA Ada、Hopper 和 Grace Hopper 处理器相结合,针对AI视频、图像生成、大型语言模型部署、推荐系统推理等需求激增的工作负载进行优化。

除了英伟达之外,微软、谷歌、ARM、Cadence和Synopsys等公司和机构都在利用AI技术进行芯片设计,以提高芯片设计的效率和精度。

例如,谷歌利用AI技术设计出了专门针对图像和视频处理的张量处理单元(TPU)芯片,该芯片在谷歌云平台上的TensorFlow框架中使用,为机器学习任务提供了高性能的计算支持。

此外,微软研究院也利用AI技术设计出了一种基于Transformer模型的神经芯片,该芯片可以并行处理多个计算任务,提高芯片的计算效率和能效。

相关文章

热门网址

AIGC热点

热点

AIGC热点

热点

-

19打开,有戏

时间线

热门标签

热门工具

本站内容源自互联网,如有内容侵犯了你的权益,请联系删除相关内容,联系邮箱:youmao@neone.com.cn

© 2010 - 2024 | 沪ICP备16045468号-5