DeepTalk深言堂 | 清华刘永进:多模态情感计算

深兰科学院打造的学习平台“DeepTalk深言堂”,于2020年1月9日首次开讲。我们有幸邀请到清华大学计算机科学与技术系的孙富春、邓志东、刘永进三位学术界知名的专家教授,特别带来三场基于最新科研动态的精彩报告

深兰科学院打造的学习平台“DeepTalk深言堂”,于2020年1月9日首次开讲。我们有幸邀请到清华大学计算机科学与技术系的孙富春、邓志东、刘永进三位学术界知名的专家教授,特别带来三场基于最新科研动态的精彩报告。

前期已分享了孙富春教授《面向灵巧操作的机器人主动感知与认知学习》,今天将特别呈现刘永进教授的精彩报告。

DeepTalk深言堂

《多模态情感计算》

清华大学 刘永进教授

报告摘要

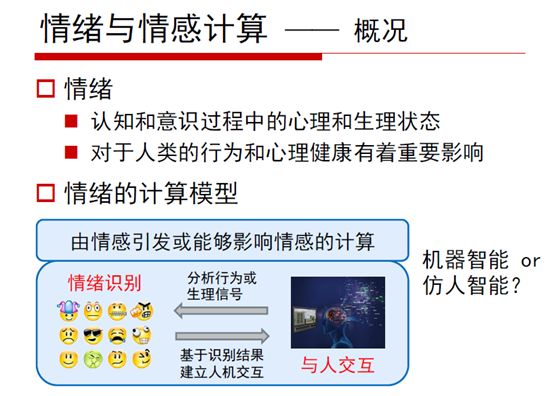

情绪是指认知和意识过程中产生的心理和生理状态,对人类的行为和心理健康有重要的影响。情绪在机器人智能交互领域有许多应用场景,例如陪伴机器人、看护机器人、送餐机器人中的虚拟客服对话与个性化图形内容生成等。多模态情感包括行为信号和生理信号的情绪识别。与行为信号相比,生理信号具有普适、自发性强、难于伪装的优点,更能反映大多数人群的真实情绪。在识别问题中,需要使用高效的机器学习算法进行情绪分类。传统方法将各电极通道的EEG信号独立处理。此次报告介绍了清华在这方面最近在考虑通道之间关联的、基于多通道脑电信号的情绪识别研究,包括稀疏图卷积神经网络和基于注意力机制+域判别器的LSTM网络。

AI中的情感计算

AI中的情感计算我们把它定位成人工智能中比较重要的体现,现在很多人说不清人工智能是什么,只能说有算法可以做到人能做的事情,能节省一些人力,这是早期算法能模拟人做的事情。但人工智能再往后发展,它的一些高层的功能跟情感就有关系了。

这里我们就要讲到情绪。情绪有一个定义,它是认知和意识过程中对心理和生理状态的测量,它是一个模糊、不精确的概念。为什么说研究高级人工智能,它很重要呢?因为情绪对于人类的行为和心理健康,包括一些产品的用户体验有非常重要的影响。

我们这里研究的情绪是指,由情感引发或能够影响情感的计算。这里我想特别强调下有关机器智能和仿人智能的区别,人工智能有时候不太区分这两种智能,但这两种智能的差别还是非常大。

机器智能完全是机器之间在进行交流,完全是逻辑运算,是机器内部的自己的运算或高性能存储,是不需要人参与的,自己有一套非常好的机制。它的存储可以做的很大,运算速度很快,可以比人突出的传递的精神信号要快很多倍,它的容错和纠错能力也非常强。

而仿人智能一定强调“人在回路”,我们强调这种智能形态里是有人的,是要为人来服务的。我们有很多学科,比如机器人、人机交互,比如我们的迎宾机器人,它不是来迎接机器人的,它是来迎接人的,有人在回路上。我们还有虚拟/增强现实、计算机图形学与可视化、图像、视频、多媒体,所有这些都是给人看的。如果是机器和机器交流,它只需要带宽,完全有一套自己的体系,可以完全突破人的生物的限制。为什么说仿人智能?因为人是一种生物的智能,它与机器智能有完全不同的形态,所以当人在回路的时候,要考虑人的感受的时候,这方面就非常重要。

人在回路有一个非常重要的因素是情感或者情绪状态,这是一个高级的、意识形态的问题。这类研究在人工智能中也比较多了,比如文本,我们的聊天机器人Siri,有聊天对话的用户界面,这些通过分析情感词、包括图形测试来回答。我们的智能客服回答的时候如果有情感词、有语气,你高兴的时候它能一起高兴,你悲伤的时候它能给你一些开导,你会觉得对面更像是一个人。

我们再举一个图形学中的例子,在人和机器人之间的交互我们有个落地的应用。一个用户的照片,我们可以给出任意一个情绪的标签,然后就可以把脸部变成对应的喜怒哀乐。进一步比如说一个冷冰冰的聊天对话的文本框,可以回答一些问题,好比看护机器人、家庭中的陪伴机器人等都有一些语气词,这都是文本层面,但在图形交互界面上还是非常少。

之前一些研究工作,写成文还是比较容易,比如说这些世界名画,我们搜集到一些人的个性化表情照片,把名画改成他们的表情。但如何落地应用呢?这是一个很大的体系,人通过很多传感器,比如脑机接口、腕表来测量身体信号,对应到一些显示,如虚拟现实、增强现实、对话聊天等,都通过这个界面来显示。

情绪识别

我们跟许多国内做情感计算的人沟通,发现基础理论并不清晰,所以我们在2017-2018年花了很多时间,跟中科院心理所、清华大学心理系一起,把基础理论先搞搞扎实。

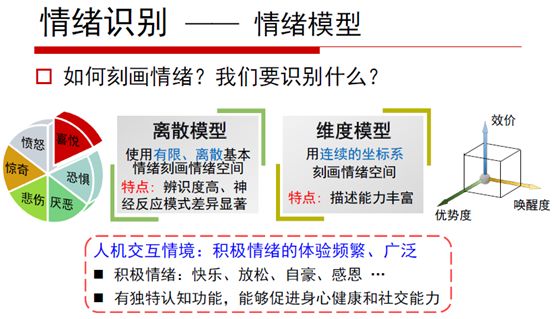

首先我们来看如何刻画人的情绪或情感模型。很多时候计算机视觉说不清,所以我们花了很长时间去理清这个情绪模型,这不是我们提的,这个概念太大,我们主要搜集了很多国际上的已有模型。

主要分为两大类,一类是离散模型,一类是维度模型。

离散模型是通过人的临床或心理学家提炼出来的,有点像聚类算法聚类出来的通过100多年大量的样本提炼出来的,包括喜悦、愤怒、惊奇、悲伤、厌恶、恐惧,它的优点在于每一类的分界线非常清晰,具有很高的辨识度,神经反应的模式非常清晰。

维度模型,它是是计算机领域比较喜欢的,是一个连续的维度,比如唤醒度、效价加上控制度,它是一个连续的坐标系,坐标中的任何一个点都可以刻画一种情绪,在描述上非常方便。但它有一个问题,在这个坐标空间中并不是线性,比如温馨和浪漫,他们的坐标点可能差得不远,但它们的神经响应模式差别特别大。有时候坐标差得比较远,其实又离得比较近,所以这个空间用起来很方便,但在神经辨识度上可能有些问题。

这个离散模型,大家仔细看的话其实会发现它的负性情绪居多,在六类经典的离散情绪中正性只有喜悦一种,其他都是负性,因为临床大部分是病人,心理有问题才会去看医生。因此清华大学心理学专家提出一种“积极心理学”,就是要把正性情绪进行细分类,传统的情绪里是没有的。我们现在讲到的情绪并不是都给病人用,更多时候比如我们到商场里遇到的客服机器人,跟它交互的时候,要区分哪些情绪状态是好的,要区分出是快乐、放松、自豪、感恩,还是其他情绪细分类。

积极情绪有独特的认知功能,能促近身心健康,提高社交能力和学习能力。我们正在理论上尝试刻画积极情绪这种模式。还有一个不一样的地方,以前的负性情绪界限非常清晰,分辨率非常高,但积极情绪是一个混合的情绪状态,是几种情绪混杂在一起诱发出来的。所以分类上不是排他式的,而是混合式的。

另外在基础理论方面,有一个Ground truth,它是一个非常模糊的概念,就像高兴和喜悦没有界限。于是,我们就花很长功夫去界定了一个Ground truth,我们就收集到传统在心理学上做的实验。

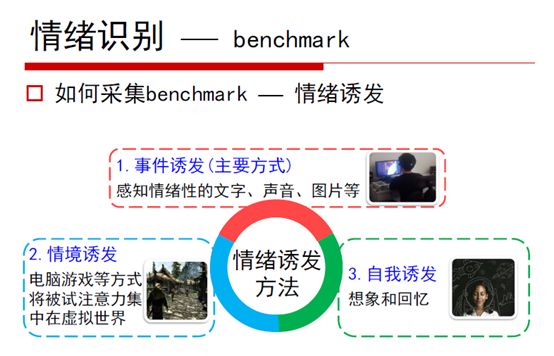

情绪诱发有几大类基础的方法:

通过实验,假定能通过一套素材诱发情绪,那我们要搜集什么样的信号去识别呢?这里基本分为两类,一类是基于行为的数据,一类是基于生理信号的数据。

基于行为的包括图像、面部表情、语音语调,或者身体的姿势。作为一个基础的Ground truth,这些比较容易收到外部因素的影响。好比人可以去控制表情和身体的姿势,隐藏真实的情绪状态。所以我们在做基础库的时候,会考虑基于生理信号,用脑电、外周生理信号,即便是受过训练的人也很难控制这些。

脑电信号

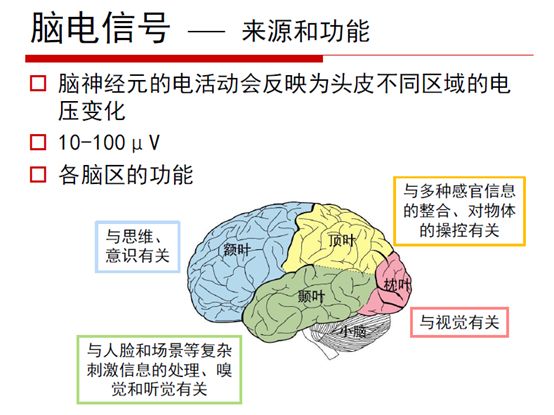

2019年我们进行了一项关于脑电的研究,分析用户在交互过程中的脑神经信息,创新性地实时在线解码在复杂多样真实环境下的情绪状态,构建情绪识别脑机接口系统,综合研究积极情绪和交互自然性的关系,为图形界面、媒体生成、自然人机交互提供理论基础和验证平台。

脑电信号的采集还不是很普及,我们知道传统医学上使用的脑电设备都是湿电极设备,要打脑电膏、涂生理盐水,实验非常麻烦,用户也不愿意去戴。我们要收集到这些Ground truth非常麻烦,但是使用开始考虑干电极设备。所以我们可以用湿电极设备来收集Ground truth,用干电极设备来应用。

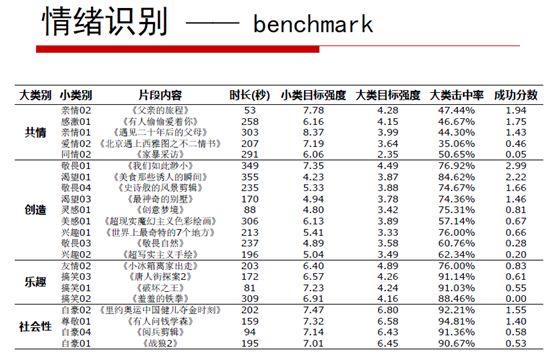

视频的建立有一套非常严格的,经得起考验的标准,收集的Ground truth一定能诱发情绪。因为情绪与文化背景有关,所以我们面向中国北方地区汉族建立了库,利用电影的素材库,因其包括语音通道和视觉通道,更接近真实场景来诱发情绪。专家经过一系列帅选评定,来判断到底是通过画面颜色还是视频内容来诱发的情绪,要把单一因素排除掉。

我们还在做的就是刻画积极情绪,比如通过腕表或其他脑电设备,可以总结出一天的情绪变化状态,就像有的腕表可以测算走路消耗的卡路里,我们也可以记录脉搏、一天情绪的分布,来建议改善健康或者学习效率等。

这是一个情绪素材的评定,过程非常艰辛,我们还是建立起来了。我们找了志愿者在中文视频网站上收集材料进行初评,然后找了专家在长度、理解性、区分度上进行评判和划分,最后开始正式实验、填写量表、观看影片,有一套标准程序。

对于积极情绪,它并不是排他性的,我们收集了20多种进行聚类,形成了几个大的区分度比较高的类别。

这套工作的基础我们做的比较扎实,建立好了这套情绪的理论数据库后,就可以在图形生成、语音画面上做很多事情。

而脑电特征与图像信号没什么区别,只是不规则图像视频比较规则可以用负电卷积做CNN,脑电并不是规则的,可以用图卷积网络来处理。

基于多通道脑电信号的情绪识别技术

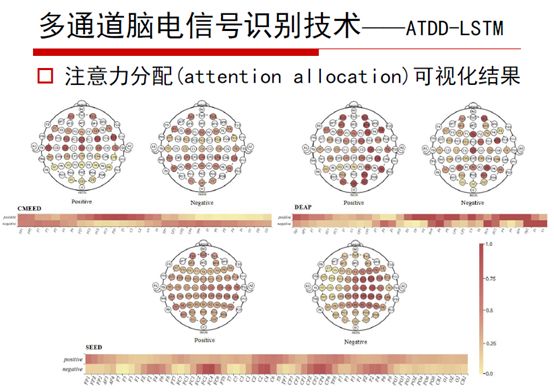

以前是基于单一某个通道的脑电信号,特征是手工设计出来的,出于医生的经验,最多能做到左半脑和右半脑有一个差,最多做到一阶特征。现在我们用自动学习来学一个非线性特征,我们的效果比较好的话,还能给神经学家建议。

我们现在通过图卷积网络,用LSTM网络把非线性特征可视化出来,给到神经学家建议和启发。

小结

情绪影响行为和心理健康,广泛应用于机器人交互、图形媒体生成领域;

在各类指标中,脑电信号因自发性强、携带信息丰富、时间分辨率高,能获得较好的情绪识别效果;

由于不同脑区的功能差异,基于多通道脑电信号的情绪识别技术逐渐产生,这些技术考虑通道间的关联关系,更符合脑电信号的特性,推动情绪研究的进一步发展。