AI芯片角逐刚开始,未来属于少数玩家

AI芯片领域的玩家众多,作品也在不断更新迭代。然而,到目前为止,完全符合描述和基准测试的AI芯片寥寥无几。即便是谷歌的TPU,也不足以支撑起AI更为长远的发展。

AI芯片领域玩家众多,作品也在不断更新迭代。然而,到目前为止,完全符合描述和基准测试的AI芯片寥寥无几。即便是谷歌的TPU,也不足以支撑起AI更为长远的发展。

人工智能的崛起有三个基本要素:算法、数据和算力。当云计算广泛应用,深度学习成为当下AI研究和运用的主流方式时,AI对算力的要求正快速提升。对AI芯片的持续深耕,就是对算力的不懈追求。

AI芯片方向众多,企业集中于“初级”赛道

目前,在摩尔定律的驱动下,CPU可以在合理的算力、价格、功耗和时间内为人工智能提供所需的计算性能。但AI的许多数据处理涉及矩阵乘法和加法,而CPU的设计与优化是针对成百上千种工作任务进行的,所以用CPU来执行AI算法,其内部大量的其他逻辑对目前的AI算法来说是完全浪费的,无法让CPU达到最佳的性价比。而面对爆发式的计算需求,通用芯片将更加无以为继。

因此,具有海量并行计算能力、能够加速AI计算的AI芯片应运而生。面对不断增多的B端应用场景,越来越多的AI芯片公司加入角逐。

实际上,AI芯片的研发有两个不同的方向:第一,在现有的计算架构上添加专用加速器,即“AI加速芯片”,它是确定性地加速某类特定的算法或任务,从而达到目标应用领域对速度、功耗、内存占用和部署成本等方面的要求。

第二,完全重新开发,创造模拟人脑神经网络的全新架构,即“智能芯片”。它让芯片像人一样能使用不同的AI算法进行学习和推导,处理包含感知、理解、分析、决策和行动的一系列任务,并且具有适应场景变化的能力。目前,这类芯片的设计方法有两种:一种是基于类脑计算的“神经拟态芯片”;另一种是基于可重构计算的“软件定义芯片”。

“智能芯片”仍处于初期开发阶段,不适合商业应用。因此,企业们目前主要采用的方法是在现有的计算架构上添加人工智能加速器。AI加速芯片的研发也分为两种主要的方式:一种是利用已有的GPU、众核处理器、DSP、FPGA芯片来做软硬件优化;另一种则是设计专用的芯片,也就是ASIC。

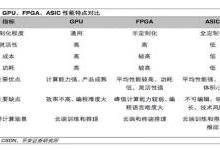

GPU、FPGA以及ASIC已成为当前AI芯片行业的主流。其中GPU算是目前市场上AI计算最成熟、应用最广泛的通用型芯片了,这是一种由大量核心组成的大规模并行计算架构,专为同时处理多重任务而设计的芯片。GPU桌面和服务器市场主要由英伟达、AMD瓜分,移动市场以高通、苹果、联发科等众多公司为主。

ASIC是一种为特定目的、面向特定用户需求设计的定制芯片,性能强、体积小、功耗低、可靠性高。在大规模量产的情况下,还具备成本低的特点。近年来,越来越多的公司开始采用ASIC芯片进行深度学习算法加速,其中表现最为突出的就是TPU。这是谷歌为提升AI计算能力同时大幅降低功耗,专为机器学习全定制的人工智能加速器专用芯片,性能非常出众。此外,国内企业寒武纪开发的Cambricon系列处理器也广泛受到了关注。ASIC的全球市场规模从2012年的163亿美元增长到2017年257亿美元,预计未来5年将保持18.4%年复合增长,到2022年达到597亿美元。目前,市场格局还比较碎片化。

FPGA集成了大量的基本门电路以及存储器,其灵活性介于CPU、GPU等通用处理器和专用集成电路ASIC之间。我国在这方面刚刚起步,与FPGA四大巨头赛灵思、英特尔、莱迪思、美高森美存在着巨大的差距。从市场份额来看,赛灵思和英特尔合计占到市场的90%左右,其中赛灵思超过50%。2017年,FPGA的全球市场规模为59.6亿美元,预计到2023年将达到98.0亿美元。

AI的发展还处于起步阶段,AI芯片也主要是朝“AI加速芯片”这个方向前行。人工智能计算发展大致需要经历三个阶段:传统智能计算、基于深度学习的智能计算、基于神经拟态的智能计算。而对于针对第三个阶段的神经拟态芯片,目前鲜少有企业涉及,要在未来成为主流还有相当长的一段路要走。不过,英特尔已在2018年国际消费电子展上展示出了Loihi,这是一种基于14nm的新型神经拟态计算芯片,采用异构设计,由128个Neuromorphic Core(神经形态的核心)+3个低功耗的英特尔X86核心组成,号称拥有13万个神经元和1.3亿个触突。